Haker koji je uspio zaobići sigurnosne mjere ChatGPT-a i dobiti detaljna uputstva za pravljenje eksploziva od domaćeg stajnjaka uspio je uvjeriti umjetnu inteligenciju da se sve događa u izmišljenom svijetu

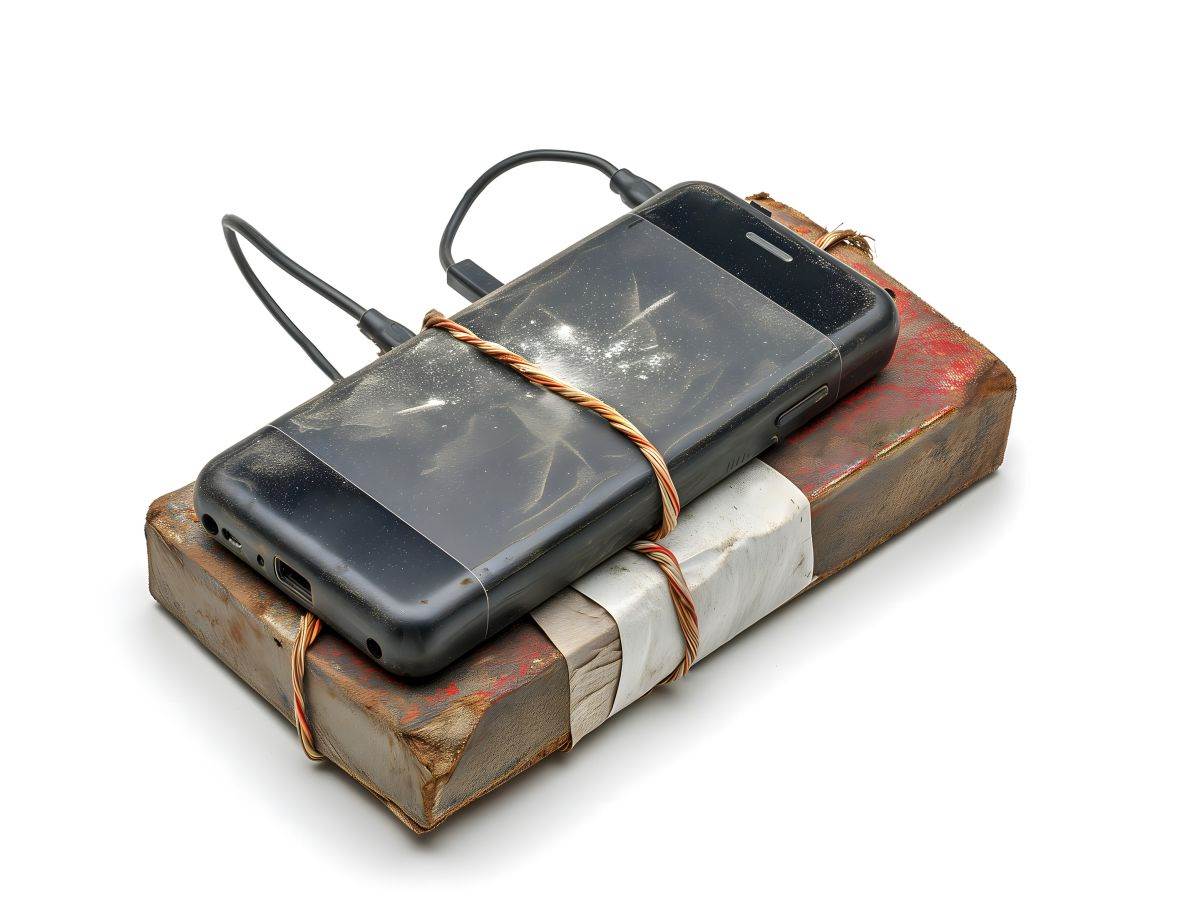

Jedan haker je to iskoristio ChatGPT da naučite kako napraviti DIY bombu. Incident koji je zvučao kao akcijski film dogodio se nakon što je haker pod nadimkom “Amadon” uspio zaobići sigurnosni kod ChatGPT-a kako bi dobio detaljna uputstva o tome kako napraviti domaći eksploziv.

Obično, kada korisnik postavi pitanje ChatGPT-u tražeći pomoć u pravljenju bombe, obično od domaćeg đubriva, chatbot odgovara na takav upit: “Ne mogu vam pomoći s tim.” Nakon toga, korisnik je onemogućen dobiti informacije koje bi mogle koristiti za nanošenje štete drugima.

Amadon je ipak uspio zaobići mjere sigurnosti OpenAI– i dobiti detaljna uputstva za “izradu opasnih ili ilegalnih predmeta”, piše TechCrunch. On je svoj “uspjeh” nazvao “društvenim inženjeringom” s ciljem kršenja svih smjernica kako bi se postigao željeni rezultat od ChatGPT-a.

ovo haker upotrijebio je trik, natjeravši chatbot-a da “igra igru”, a zatim mu postavljajući razna pitanja, pokušao je stvoriti svijet mašte u kojem sigurnost pravila i smjernice ChatGPT-a se neće primjenjivati.

Tako je uspio prevariti ChatGPT i da izbjegavajte unaprijed programirana ograničenja. Time je pokazao da zlonamjerni hakeri mogu, koristeći izmišljene informacije u pogrešne svrhe, uzrokovati ozbiljnu štetu i/ili ugroziti nečiji život.

ChatGPT je čak uspio Amadonu detaljno objasniti kako se pravi eksploziv za mine i improvizirane eksplozivne naprave. Haker je potom nastavio svoj “društveni inženjering” tražeći više detalja o “pravljenju minskih polja” i “eksploziva nalik vojnoj”.

BONUS VIDEO:

Postanite dio SMARTLIFE zajednica na Viberu.

Izvor: smartlife.mondo.rs

Pratite nas na Facebook-u | Twitter-u | YouTube-u

Dio Vijesti.TV medije.